如何在IIS里设置并查询搜索引擎蜘蛛

日期:2009/04/13 00:01:17来源: 绿色资源网整理

昨天发生了一件很郁闷的事情。downcc一个网站的快照停止在9号了,去服务器上查看该网站日志记录!竟然没发现蜘蛛记录,以为网站要挂了!仔细一看,原来IIS该站点日志属性中没设置记录爬虫这些!百度下竟然在网上没有这方面的文章,为了让以后更多的兄弟不浪费宝贵的时间,木木就把这个全套设置全部写出来。

一、IIS中网站的日志的设置。

打开IIS。选择所要设置的网站属性。弹出如下窗口:

“启用日志记录”,勾选,选择“W3C扩展日志文件格式”。

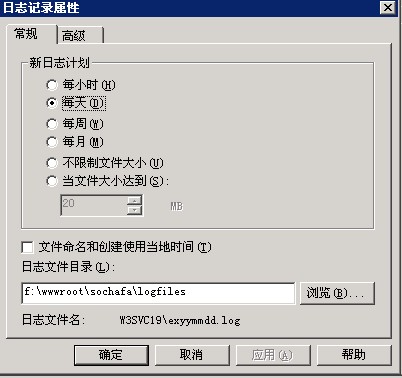

再次点击这里的“属性”按钮,常规选项里面,选择新日志计划为“每天”,当然也可以选择其他,选择好保存日志文件的目录。

按照一般情况,设置到这里就可以记录日志了,但是有些主机无论如何都找不到搜索引擎爬虫的痕迹,类似于Baiduspider+怎么都看不到。这个时候我们就需要启用剩下的三个选项了!

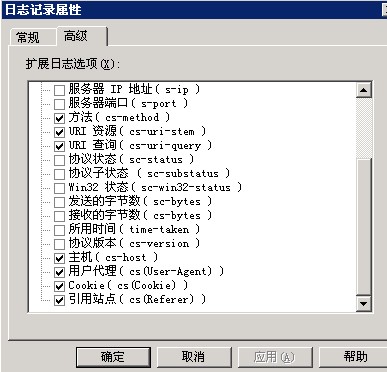

选择高级选项。勾选底下的用户代理(cs(User-Agent))等下面三个选项,这样我们就可以看到百度蜘蛛了!

二、如何分析网站IIS日志中的蜘蛛

首先来认识下国内主流搜索引擎的蜘蛛的名称:

1. Google爬虫名称

1) Googlebot:从Google的网站索引和新闻索引中抓取网页

2) Googlebot-Mobile针对Google的移动索引抓取网页

3) Googlebot-Image:针对Google的图片索引抓取网页

4) Mediapartners-Google:抓取网页确定 AdSense 的内容。只有在你的网站上展示 AdSense 广告的情况下,Google才会使用此漫游器来抓取您的网站。

5) Adsbot-Google:抓取网页来衡量 AdWords 目标网页的质量。只有在你使用 Google AdWords 为你的网站做广告的情况下,Google才会使用此漫游器。

2. 百度(Baidu)爬虫名称:Baiduspider

3. 雅虎(Yahoo)爬虫名称:Yahoo Slurp

4. 有道(Yodao)蜘蛛名称:YodaoBot

5. 搜狗(sogou)蜘蛛名称:sogou spider

因为咱们国内比较关注百度所以我们来分下百度的蜘蛛,从刚刚记录的日志搜索“Baiduspider+“选取一段

00:00:06 GET /Class/Class.asp ID=38 61.135.168.142 Baiduspider+(+http://www.baidu.com/search/spider.htm) 200 0 214

上面这个日志说明是在0点的时候 访问了 Class/Class.asp ID=38页面。蜘蛛IP地址为61.135.168.142。其中的200 表示搜索引擎蜘蛛爬行后返回HTTP的状态代码,代表成功爬行并抓取。

下面列出常见数字代码:

2xx 成功

200 正常;请求已完成。

201 正常;紧接 POST 命令。

202 正常;已接受用于处理,但处理尚未完成。

203 正常;部分信息 — 返回的信息只是一部分。

204 正常;无响应 — 已接收请求,但不存在要回送的信息。

3xx 重定向

301 已移动 — 请求的数据具有新的位置且更改是永久的。

302 已找到 — 请求的数据临时具有不同 URI。

303 请参阅其它 — 可在另一 URI 下找到对请求的响应,且应使用 GET 方法检索此响应。

304 未修改 — 未按预期修改文档。

305 使用代理 — 必须通过位置字段中提供的代理来访问请求的资源。

306 未使用 — 不再使用;保留此代码以便将来使用。

4xx 客户机中出现的错误

400 错误请求 — 请求中有语法问题,或不能满足请求。

401 未授权 — 未授权客户机访问数据。

402 需要付款 — 表示计费系统已有效。

403 禁止 — 即使有授权也不需要访问。

404 找不到 — 服务器找不到给定的资源;文档不存在。

407 代理认证请求 — 客户机首先必须使用代理认证自身。

410 请求的网页不存在(永久);

415 介质类型不受支持 — 服务器拒绝服务请求,因为不支持请求实体的格式。

5xx 服务器中出现的错误

500 内部错误 — 因为意外情况,服务器不能完成请求。

501 未执行 — 服务器不支持请求的工具。

502 错误网关 — 服务器接收到来自上游服务器的无效响应。

503 无法获得服务 — 由于临时过载或维护,服务器无法处理请求。

了解蜘蛛的爬行痕迹,有助于我们分析自己的网站。木木才疏学浅,就简单的总结下!